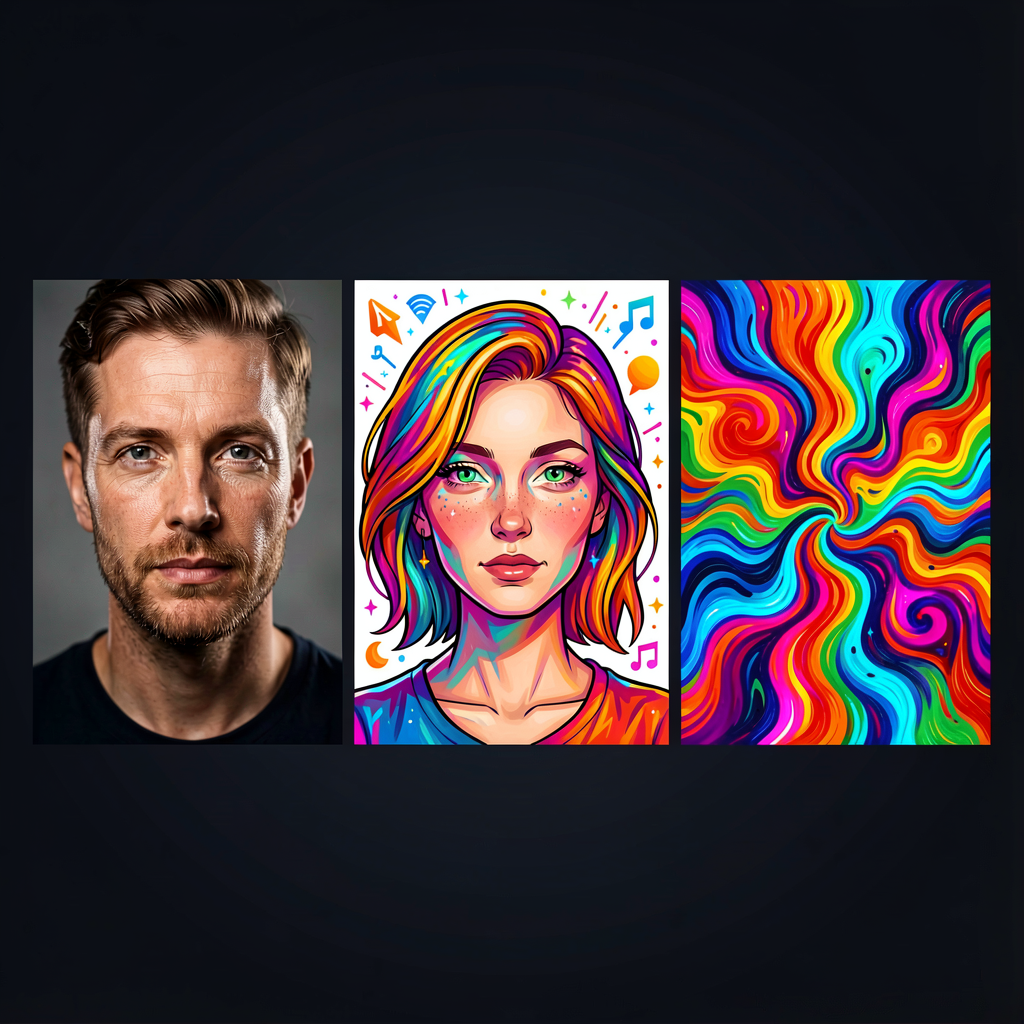

2026년 AI 이미지 생성 도구 비교 — Midjourney, ChatGPT, Stable Diffusion

AI 이미지 생성 3대장 비교. 각 도구의 강점, 가격, 사용법 차이를 정리하고 상황별 추천까지.

"고양이가 우주복 입고 화성에서 커피 마시는 그림" — 이런 말도 안 되는 묘사를 텍스트로 쓰면 진짜 이미지가 나오는 시대다. AI 이미지 생성 도구가 2022년부터 폭발적으로 발전했는데, 2026년 현재 선택지가 너무 많아서 오히려 뭘 써야 할지 모르겠다는 사람이 많다.

결론부터 말하면, 만능인 도구는 없다. 각각 잘하는 게 다르다.

3대장 한눈에

| Midjourney v7 | GPT Image 1.5 (ChatGPT) | Stable Diffusion 3.5 | |

|---|---|---|---|

| 운영 | Midjourney, Inc. | OpenAI | Stability AI + 커뮤니티 |

| 사용 방식 | 웹/Discord | ChatGPT 통합 | 로컬 설치 or 웹 서비스 |

| 가격 | $10~$120/월 | ChatGPT 구독 포함 | 무료 (로컬) |

| 강점 | 심미적 완성도 | 프롬프트 이해도, 텍스트 정확도 | 자유도, 커스터마이징 |

| 약점 | 텍스트 렌더링 약함 | Midjourney급 감성은 부족 | 진입 장벽 높음 |

Midjourney v7 — 예쁜 건 여전히 얘가 최고

2025년 4월에 출시된 v7은 아키텍처를 밑바닥부터 다시 만들었다. 결과물이 한마디로 작품 같다는 건 여전한데, 이전 버전 대비 잘못된 생성(bad generations)이 크게 줄었다. 별다른 프롬프트 엔지니어링 없이도 구도, 조명, 색감이 세련되게 나온다.

웹 에디터가 본격적으로 붙으면서 generative fill, 인페인팅, 아웃페인팅까지 브라우저에서 된다. 영상 생성(V1, 최대 21초)까지 지원하기 시작했고, 2026년 1월에 나온 Niji 7로 애니메이션/일러스트 특화 모드도 강화됐다.

단점은 텍스트 렌더링이 여전히 약하다는 거다. 이미지 안에 글자를 정확히 넣는 건 아직 GPT Image 쪽이 훨씬 낫다. 그리고 무료 티어가 없어서 일단 결제를 해야 써볼 수 있다.

가격은 Basic $10/월, Standard $30/월, Pro $60/월. Standard 이상이면 무제한 릴렉스 모드를 쓸 수 있어서, 급하지 않은 작업은 느린 큐에 넣어두는 식으로 활용 가능하다.

GPT Image 1.5 (ChatGPT 통합) — 가장 편하고 똑똑한 선택

2025년 12월에 DALL-E 3를 대체하면서 나온 GPT Image 1.5가 판도를 바꿨다. 별도의 이미지 파이프라인이 아니라 ChatGPT에 네이티브로 통합된 멀티모달 모델이라, 이전과는 차원이 다른 프롬프트 이해도가 나온다. LM Arena 이미지 생성 부문에서 최상위 ELO 점수로 1위를 기록하고 있다.

"배경을 좀 더 어둡게 해줘", "오른쪽에 나무 하나 추가해줘", "텍스트를 한국어로 바꿔줘" — 이런 자연어 요청으로 이미지를 점진적으로 다듬을 수 있다. 복잡한 장면을 여러 요소, 공간 관계, 세부 사항까지 정확하게 묘사하면 그대로 만들어내는 능력은 경쟁 도구 중 가장 뛰어나다.

텍스트 렌더링 정확도가 약 95%까지 올라왔다. 이미지 안에 글자를 넣는 건 AI 이미지 생성의 오랜 약점이었는데, 한국어 텍스트도 상당히 정확하게 들어간다. 이 부분은 Midjourney보다 확실히 앞선다.

약점은 Midjourney 대비 심미적 완성도가 한 단계 아래라는 점. 충분히 예쁘지만, Midjourney 특유의 "작품 느낌"까지는 안 난다. 그리고 콘텐츠 정책이 엄격해서 생성할 수 있는 이미지의 범위가 좁은 편이다.

ChatGPT Plus($20/월)나 Pro($200/월) 구독에 포함되어 있어서, 이미 ChatGPT를 쓰고 있다면 추가 비용 없이 쓸 수 있다는 것도 장점이다. 참고로 기존 DALL-E 2/3 API는 2026년 5월에 종료 예정이다.

Stable Diffusion — 자유도의 끝판왕

오픈소스 진영의 대표. Stable Diffusion 3.5가 81억 개 파라미터의 Multimodal Diffusion Transformer 아키텍처로 올라오면서 품질이 한 단계 올랐다. 로컬에서 돌릴 수 있다는 게 가장 큰 차별점이다. GPU만 있으면 무료로 무제한 생성이 가능하고, LoRA 파인튜닝이나 ControlNet 컨디셔닝도 자유롭다.

여기에 FLUX 생태계가 새로운 축으로 떠올랐다. Apache 2.0 라이선스라 상업적 사용이 자유롭고, FLUX.2 Klein은 1초 이내 생성이 가능한 수준까지 왔다. Civitai 같은 플랫폼에서 SD와 FLUX 기반 커스텀 모델을 수천 개 단위로 찾아 쓸 수 있다. 이런 수준의 커스터마이징은 Midjourney나 GPT Image에서는 불가능하다.

ComfyUI나 Automatic1111 같은 인터페이스를 통해 워크플로우를 노드 기반으로 구성할 수도 있다. 이미지 생성 → 업스케일 → 배경 제거 → 스타일 전이 같은 복잡한 파이프라인을 시각적으로 만들 수 있어서, 일단 익숙해지면 생산성이 높다.

대신 진입 장벽이 높다. 설치 과정이 복잡하고 (Python 환경, CUDA 설정, 모델 다운로드...), 좋은 결과를 얻으려면 프롬프트 엔지니어링과 파라미터 튜닝에 시간을 투자해야 한다. "설치하고 바로 예쁜 그림"을 기대하면 실망할 수 있다.

로컬 설치가 부담되면 RunPod, Replicate 같은 클라우드 서비스에서 Stable Diffusion을 돌리는 방법도 있다.

용도별 추천

블로그 썸네일, SNS 콘텐츠 — Midjourney v7이 무난하다. 프롬프트 대충 써도 예쁘게 나오니까 비전문가도 빠르게 결과를 낼 수 있다.

대화하면서 수정이 필요한 작업 — GPT Image 1.5. "여기 좀 고쳐줘" 식의 반복 수정이 자연스럽다. 텍스트가 포함된 이미지나 프레젠테이션 자료 만들 때 특히 편하다.

대량 생성, 커스텀 스타일 — Stable Diffusion 또는 FLUX. 특정 스타일로 수백 장 생성하거나, 자사 제품 이미지를 학습시켜서 쓰는 식의 활용에는 대안이 없다.

개발자가 빠르게 프로토타입 이미지 뽑기 — GPT Image 1.5가 가장 편하다. 이미 ChatGPT를 쓰고 있다면 추가 도구 설치 없이 바로 가능하니까.

속도가 중요한 작업 — FLUX.2 Klein은 1초 이내 생성이 가능하고, Google Imagen 4 Fast는 약 2~3초로 빠르다.

어차피 도구마다 강점이 달라서, 진지하게 AI 이미지 생성을 활용하려면 둘 이상을 조합하게 되는 경우가 많다. Midjourney로 컨셉을 잡고, Stable Diffusion/FLUX로 변형하고, GPT Image로 텍스트를 입히는 식으로.

결국 어떤 도구를 쓰든 "좋은 프롬프트를 쓰는 능력"이 결과를 좌우한다는 건 텍스트 AI와 다를 게 없다.